No creo que vaya a acabarse el subsidio de tokens. Y eso dice mucho sobre el futuro de la IA

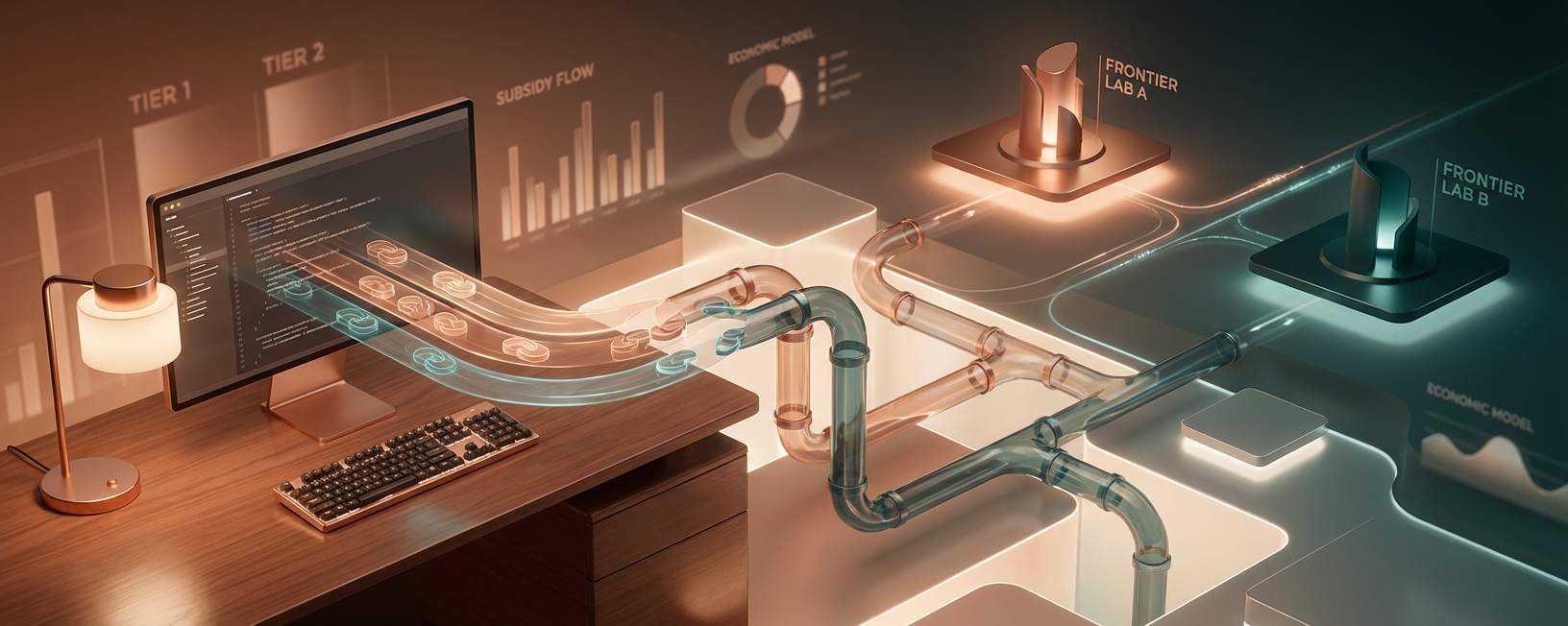

Hay una idea que empiezo a escuchar cada vez más: que este momento de “tokens subsidiados” se va a acabar.

Que ahora OpenAI y Anthropic nos están dejando usar ChatGPT, Codex o Claude a precios ridículos comparados con la API, pero que eso solo es una fase temporal. Que cuando ya estemos todos enganchados, nos tocará pagar el “precio real”.

Yo no lo veo así.

No digo que no vayan a cambiar límites, planes o condiciones. Claro que lo harán. Tampoco digo que vayan a regalar inteligencia infinita para siempre. Eso sería ingenuo.

Lo que digo es otra cosa: no creo que el subsidio desaparezca. Creo que se va a convertir en una ventaja competitiva estructural.

La inteligencia baja de precio, aunque el producto no lo haga

Mi sensación es que mucha gente está mezclando dos cosas distintas:

- El coste real de producir inteligencia

- El precio del producto que compramos

Y no son lo mismo.

La inteligencia, entendida como capacidad de inferencia, lleva una tendencia clarísima: abaratarse con el tiempo. Los modelos frontera de hoy siguen siendo caros, sí. Pero sus modelos inmediatamente inferiores están tirados de precio comparados con lo que costaban hace uno o dos años. Y ese patrón es el mismo que hemos visto una y otra vez en tecnología: lo que hoy es élite mañana se commoditiza.

Por eso no creo que el escenario probable sea: “se acabó la fiesta, ahora todos a pagar tokens a precio API”.

Creo que el escenario probable es este:

- el coste interno de servir esos modelos seguirá bajando

- las empresas intentarán que los usemos para cada vez más cosas

- y el precio visible de las suscripciones premium no cambiará demasiado

En otras palabras: no van a matar el subsidio; van a hacer que por fin les salgan las cuentas con él.

Y eso es muy distinto.

El negocio no está en venderte tokens. Está en venderte hábito

OpenAI y Anthropic no están construyendo solo modelos. Están construyendo productos.

Y un producto no se optimiza para que entiendas bien el coste marginal de cada petición. Se optimiza para que:

- te resulte útil todos los días

- lo incorpores a tu trabajo

- dependas de él cada vez más

- y sientas que subir al siguiente plan tiene sentido

Por eso creo que el movimiento natural no es que nos empiecen a cobrar la API “tal cual”, sino que intenten llevarnos a planes cada vez más altos.

Ahora existen niveles como 20 y 200. Mi impresión es que el objetivo no es destruir ese esquema, sino conseguir que a más gente le parezca razonable vivir en el escalón alto. Especialmente a programadores, equipos técnicos y perfiles intensivos.

Eso encaja mucho mejor con cómo funcionan las empresas de software.

No te venden unidades de coste.

Te venden una propuesta de valor que quieres seguir pagando.

Además, no pueden pasarse de listos

Aquí hay otro punto importante.

Aunque quisieran apretar muchísimo el precio, no están solos en el mercado.

OpenAI y Anthropic están en una guerra encarnizada. Google sigue ahí. Y los modelos chinos vienen fortísimo, con una relación calidad/precio que hace muy difícil ponerse demasiado arrogante.

A eso súmale otra presión más lenta, pero real: los modelos locales van mejorando. Todavía no están para reemplazar todo en la mayoría de flujos, pero sí ponen un suelo competitivo. Y, sobre todo, obligan a que la idea de “precio razonable” no pueda despegarse demasiado de la realidad.

Hoy mucha gente no se plantea seriamente cambiarse a modelos más baratos porque los modelos punteros siguen compensando y el coste aún es asumible.

Pero si el precio se disparara de verdad, eso cambiaría rápido.

La gente empezaría a:

- probar alternativas chinas

- optimizar flujos para consumir menos

- usar modelos más baratos en más pasos

- y plantearse cada vez más la ejecución local donde tenga sentido

Por eso no me veo claro el argumento de “cuando estemos enganchados pagaremos lo que sea”.

No. Pagaremos mucho si sigue compensando. En cuanto deje de compensar, buscaremos otra cosa.

Y ellos lo saben.

¿Entonces la IA es una burbuja?

Mi opinión: no en el sentido simplón en el que mucha gente lo dice.

¿Hay hype? Por supuesto.

¿Hay muchísimo humo? También.

¿Hay empresas metiendo “IA” a presión en cualquier slide para levantar dinero? Sin ninguna duda.

Pero una burbuja de verdad, en el sentido fuerte, suele apoyarse en una promesa enorme con una utilidad práctica todavía muy pobre.

Y en programación, sinceramente, eso ya no es lo que estamos viendo.

Desde noviembre hasta ahora hemos visto un cambio muy serio.

No hablo de benchmarks. Me dan bastante igual.

Hablo del uso real, del día a día. De lo que pasa cuando te sientas a trabajar.

Hace unos meses el modelo encajaba bastante bien como copiloto. Útil, sí. A veces brillante. Pero todavía muy dependiente, muy frágil, muy dado a necesitar microgestión constante.

Ahora estamos entrando en otra fase.

No digo que programe solo ni que podamos desaparecer del proceso. Pero sí estamos empezando a asumir que podemos darle bastante más manga ancha, dejarle resolver bloques más grandes, orquestarlo, supervisarlo y corregirlo en vez de dictarle cada tecla.

Eso ya no es un copiloto.

Eso empieza a parecerse a un delegado.

Y ese cambio no es menor. Es un cambio de régimen.

Pensar que “hemos tocado techo” no encaja con lo que estamos viendo

Últimamente también escucho mucho lo de que los LLM han tocado techo. Que los Transformers ya han dado todo lo que podían dar. Que lo grande ya ha pasado.

Yo no veo evidencia práctica de eso. Al menos no en programación.

Si de verdad estuviéramos en un techo funcional, no habríamos visto este salto tan claro en utilidad real en tan pocos meses.

Y aquí hay una matización importante: parte del salto seguramente viene de modelos mejores, sí. Pero otra parte viene de algo igual o más importante:

- mejor entrenamiento para tareas de desarrollo

- mejores herramientas

- mejores contextos

- mejores arneses

- mejores formas de mantener estado

- mejores flujos de trabajo alrededor del modelo

O sea: incluso si alguien quisiera defender que el “modelo puro” no está mejorando tanto, seguiría teniendo un problema.

Porque el sistema completo sí lo está haciendo.

Y al final lo que usamos no es el modelo en aislamiento. Lo que usamos es el sistema entero.

Incluso aunque los modelos se congelaran hoy, aún nos quedarían años de mejora

Para mí, este es el punto más importante de todos.

Imagina, por un momento, que mañana se detuviera el progreso del modelo base. Que no hubiera un GPT mejor, un Claude mejor o un Gemini mejor. Que nos quedáramos exactamente con lo que tenemos hoy.

¿Se frenaría por eso el progreso real de la IA aplicada al trabajo?

Yo creo que no. Ni de lejos.

Pienso que todavía estamos lejísimos de sacarles el máximo partido a los modelos actuales.

Y ese margen no está solo en la “inteligencia” del modelo. Está en todo lo demás:

- cómo le damos contexto

- cómo partimos las tareas

- cómo validamos el resultado

- cómo hacemos retries

- cómo integramos tools

- cómo diseñamos interfaces

- cómo construimos memoria y estado

- cómo organizamos el trabajo humano alrededor del agente

Confundir el límite del modelo con el límite del sistema es uno de los errores más grandes de esta etapa.

Porque puede que un modelo mejore un 15%. Pero un sistema bien diseñado alrededor de ese modelo puede multiplicar por mucho más el valor real que eres capaz de obtener.

Por eso creo que estamos todavía en una fase muy temprana.

No porque “todo vaya a mejorar mágicamente” y ya está. Sino porque todavía estamos aprendiendo a construir de verdad alrededor de estas capacidades.

Mi apuesta

Mi apuesta, hoy, es esta:

- No se va a acabar el subsidio de tokens

- Se va a consolidar como parte del producto

- La IA no está cerca de llegar a su tope en programación

- No estamos ni remotamente cerca del límite práctico de lo que podemos hacer con los LLM

Lo que sí creo es que estamos dejando atrás una primera fase muy ingenua.

La fase de “mira qué impresionante este demo”.

Y estamos entrando en otra mucho más interesante:

la fase en la que la pregunta ya no es si esto sirve, sino cómo se diseña bien para sacarle todo el partido.

Y ahí, sinceramente, nos quedan años de avance por delante.

Cómo conseguir la localización amplia en Android

Cómo pedir permisos en Jetpack Compose